RiskOS

Détection de fraude augmentée par IA agentique

Victor Soussan · Product Design

Contexte

Les interfaces agentiques posent une question intéressante du point de vue du product design : quand une IA participe à un processus de décision, comment maintenir la personne qui décide dans une posture active ? Si l'IA fait trop, l'humain se désengage. Si elle manque de transparence, la confiance s'effrite.

La détection de fraude dans le secteur bancaire européen offrait un contexte naturel pour explorer cette question. Les analystes travaillent sous contrainte de temps, 80 % de leurs alertes se révèlent être de fausses alarmes, et la décision finale leur revient toujours.

RiskOS est le prototype que j'ai construit pour tester des idées autour de cet équilibre.

Observation initiale

Un analyste fraude dans une néobanque européenne traite 80 à 150 alertes par vacation. La plupart sont sans suite.

Dans beaucoup d'équipes, l'outil du quotidien reste un tableur et un jeu de règles fixes. Pas de contexte, pas de tri par pertinence, pas de mémoire des cas précédents.

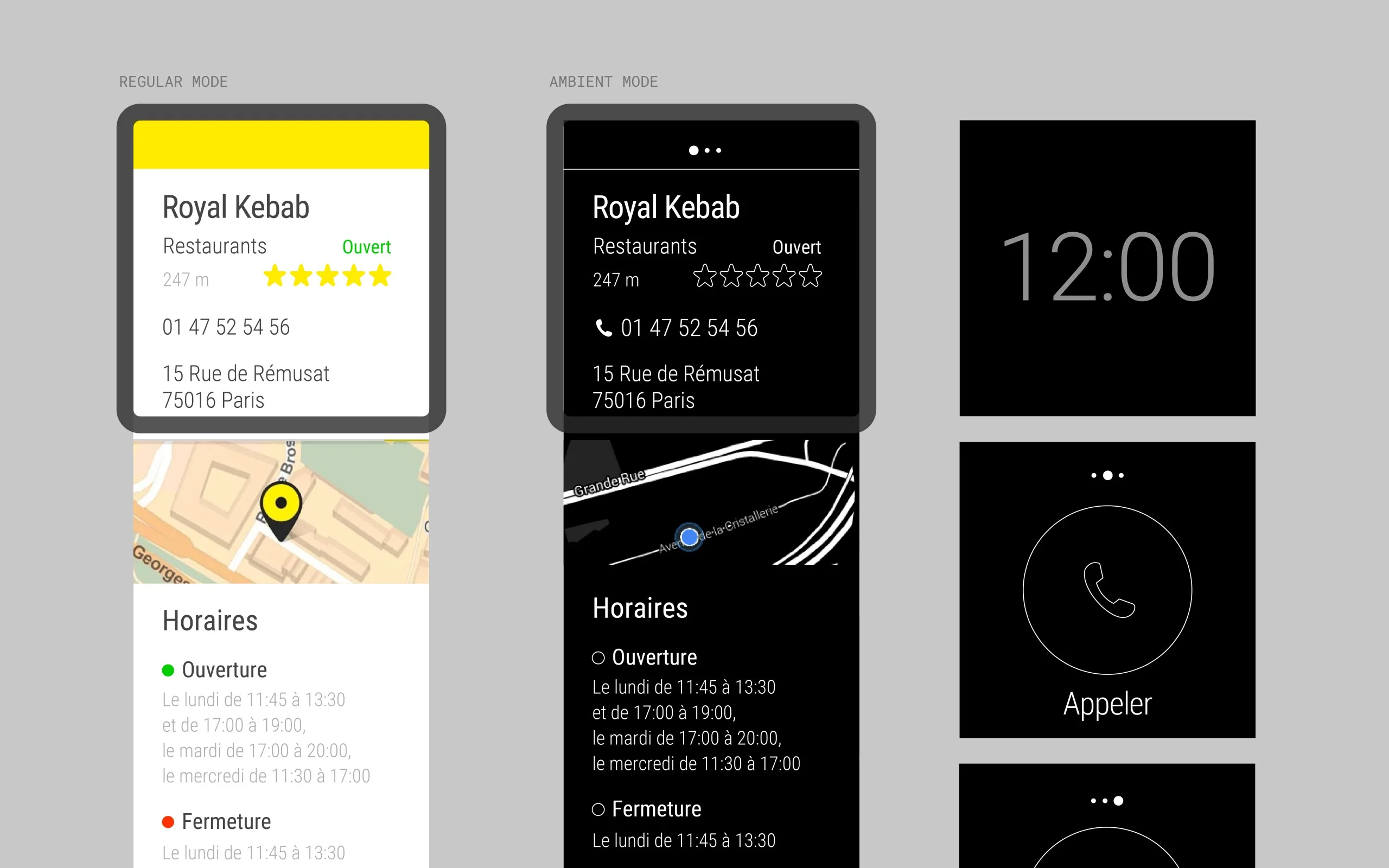

Mêmes données, deux lectures.

À gauche, le flux d'alertes tel que la plupart des établissements le reçoivent. À droite, les mêmes informations organisées dans RiskOS.

Approche de design

La question centrale : l'IA peut-elle prendre en charge la préparation tout en laissant à l'analyste la pleine maîtrise de la décision ?

Trois principes ont guidé le design :

- •L'IA pose le contexte pour que l'analyste puisse réfléchir clairement. Elle ne décide pas.

- •Le raisonnement doit être lisible, pas réduit à un chiffre.

- •Quand l'analyste agit, le résultat doit être visible au-delà de l'outil.

Où se place RiskOS dans le processus.

Une transaction suspecte passe par les règles automatiques. Si signalée, l'alerte entre dans une file. L'IA l'analyse. L'analyste examine et tranche.

Trier sous contrainte de temps

L'analyste ouvre sa session. Cinq cas l'attendent, classés par niveau de risque.

Vue de triage

Frustration : Sans tri, l'analyste parcourt toute la liste à la main.

Bénéfice : Priorités colorées et compteur en direct. Le tri prend quelques secondes.

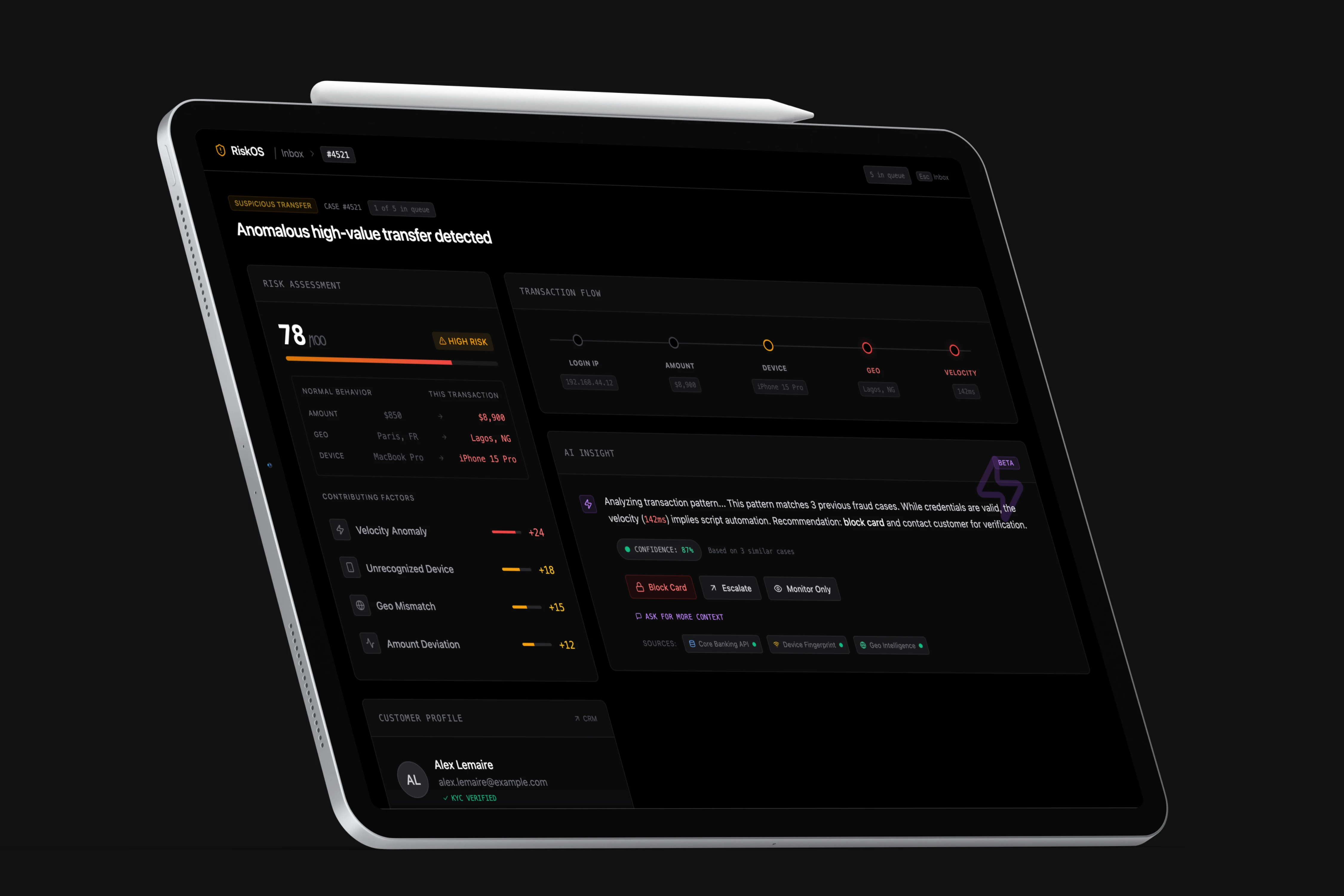

Rendre le raisonnement de l'IA lisible

L'IA rédige son analyse en temps réel, mot par mot. Les éléments pertinents sont mis en évidence au fur et à mesure.

Les boutons d'action restent masqués jusqu'à la fin de l'analyse. L'analyste lit l'intégralité du raisonnement avant de pouvoir décider.

Analyse IA, en direct

Frustration : D'habitude, l'analyste reçoit un chiffre de risque sans explication.

Bénéfice : Ici l'IA écrit ce qu'elle a trouvé, étape par étape. L'analyste lit le raisonnement, puis il décide.

Agir sur un cas

L'analyste choisit : bloquer la carte, transmettre à un senior, ou surveiller. Un écran récapitule ce qui s'est passé. Puis apparaissent le message Slack à l'équipe fraude, et le SMS au client.

Confirmation et suite

Frustration : D'habitude, l'analyste agit et ne voit jamais la suite.

Bénéfice : Chaque action laisse une trace visible.

Résoudre une fausse alerte en huit secondes

Une alerte de risque moyen arrive. L'IA passe l'historique en revue et ne trouve rien d'anormal. L'analyste confirme d'un clic.

Fausse alerte, résolue

Traiter une file complète

L'analyste traite cinq cas en séquence. Après chaque résolution, le cas suivant se charge automatiquement. Cinq cas résolus, 92 secondes au total.

Enchaînement et bilan de session

Observations

Deux enseignements qui s'appliquent au-delà de la détection de fraude.

Le streaming du raisonnement construit la confiance.

Quand l'IA écrit son analyse mot par mot, l'analyste suit et se forge sa propre opinion en parallèle. Un score de confiance affiché après coup demande la confiance sans montrer le travail.

Masquer les boutons tant que l'analyse est en cours change la lecture.

Les boutons de décision n'apparaissent qu'une fois l'analyse terminée. Sous contrainte de temps, les utilisateurs cliquent sur la première option disponible. Cette contrainte donne au raisonnement le temps d'être reçu.

Je retrouve ces dynamiques dans d'autres contextes : conformité, triage médical, modération de contenu, gestion d'incidents.

Périmètre technique

Prototype fonctionnel. React 18, Vite, Tailwind CSS. Déployé sur Vercel.